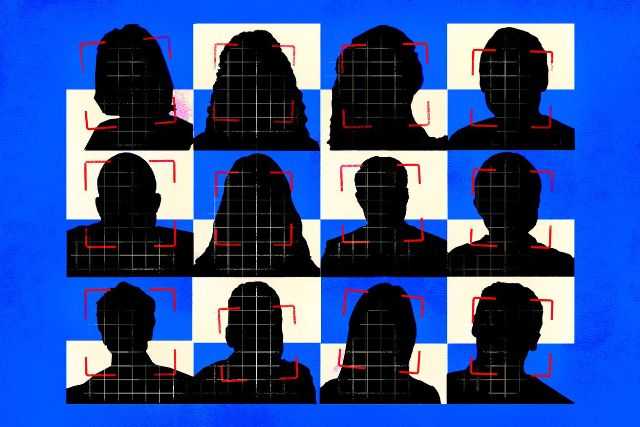

لا يمثل التزييف العميق مشكلة كبيرة عبر منصة فيسبوك في الوقت الحالي، ولكن الشركة تواصل تمويل الأبحاث في التكنولوجيا للحماية من التهديدات المستقبلية.

ويمثل أحدث عمل لها هو تعاون مع أكاديميين من جامعة ولاية ميشيغان، مع الفريق المشترك الذي ابتكر طريقة لعكس هندسة التزييف العميق.

وتعمل الطريقة على تحليل الصور التي تم إنشاؤها بواسطة الذكاء الاصطناعي للكشف عن خصائص نموذج التعلم الآلي الذي أنشأها.

وهذا العمل مفيد لأنه يمكن أن يساعد فيسبوك في تعقب الجهات الفاعلة التي تنشر التزييف العميق عبر شبكات التواصل الاجتماعي المختلفة.

وقد يتضمن هذا المحتوى معلومات مضللة أو مواد إباحية، وهي تطبيق شائع لتقنية التزييف العميق. وفي الوقت الحالي، لا يزال العمل في مرحلة البحث وليس جاهزًا للنشر.

وتمكنت الدراسات السابقة في هذا المجال من تحديد أي نموذج معروف للذكاء الاصطناعي أدى إلى إنشاء التزييف العميق.

اقرأ أيضًا: خطط مايكروسوفت المتوقعة للإصدار القادم من نظام التشغيل ويندوز

ولكن هذا العمل، بقيادة فيشال أسناني من جامعة ولاية ميشيغان، يخطو خطوة إلى الأمام من خلال تحديد السمات المعمارية لنماذج غير معروفة.

ويجب ضبط هذه السمات، المعروفة باسم البارامترات الفائقة، في كل نموذج للتعلم الآلي مثل الأجزاء الموجودة في المحرك.

وتترك هذه السمات بشكل جماعي بصمة فريدة عبر الصورة النهائية التي يمكن استخدامها بعد ذلك لتحديد مصدرها.

ومن المهم تحديد سمات النماذج غير المعروفة، كما يقول رئيس أبحاث فيسبوك، وذلك لأن برامج التزييف العميق سهلة التخصيص.

اقرأ أيضًا: إيلون ماسك يعرض Cyberpunk 2077 عبر تيسلا

ومن المحتمل أن يسمح هذا للجهات الفاعلة بتغطية مساراتها إذا كان المحققون يحاولون تتبع نشاطهم.

فيسبوك والتزييف العميق:

يقارن رئيس أبحاث فيسبوك العمل بالتقنيات المستخدمة لتحديد نموذج الكاميرا الذي تم استخدامه لالتقاط صورة من خلال البحث عن الأنماط في الصورة الناتجة.

ويمكن للخوارزمية الناتجة تحديد سمات النموذج التوليدي. كما يمكنها أيضًا تحديد النموذج المعروف الذي أنشأ الصورة وما إذا كانت الصورة مزيفة في المقام الأول.

ولكن من المهم ملاحظة أنه حتى هذه النتائج المتطورة لا يمكن الاعتماد عليها على الإطلاق.

اقرأ أيضًا: الذكاء الاصطناعي من جوجل يصمم الرقاقات بشكل أسرع من البشر

وعندما أجرت فيسبوك مسابقة اكتشاف التزييف العميق العام الماضي، كانت الخوارزمية الفائزة قادرة على اكتشاف مقاطع الفيديو التي تم التلاعب بها بواسطة الذكاء الاصطناعي بنسبة 65.18 في المئة من الوقت فقط.

وقال الباحثون المعنيون إن اكتشاف التزييف العميق باستخدام الخوارزميات لا يزال إلى حد كبير مشكلة لم يتم حلها.

ويعود جزء من السبب في ذلك إلى أن مجال الذكاء الاصطناعي التوليدي نشط للغاية. ويتم نشر تقنيات جديدة كل يوم، ويكاد يكون من المستحيل على أي فلتر مواكبة ذلك.

ويدرك المشاركون في هذا المجال هذه الديناميكية. وعند السؤال عما إذا كان نشر الخوارزمية الجديدة يؤدي إلى بحث يمكن أن يتم اكتشافه من خلال هذه الأساليب، يوافق رئيس أبحاث فيسبوك قائلًا: أتوقع ذلك.